Você precisa se perguntar: os testes A/B que estamos conduzindo hoje, estão gerando aumento de receita? A técnica de experimentação é ótima na teoria: quero aumentar a conversão, então crio um teste com base em uma suposição e coloco essa suposição à prova.

O problema disso é que para conseguir validade estatística, um teste A/B demora. Mesmo que você tenha amostragens de milhões de pessoas, você precisa cobrir anormalidades, eventos externos, então teria que rodá-lo por no mínimo uma semana.

Por conta disso, há uma limitação de quantos experimentos podem rodar em um ano, mesmo que estejam paralelizados entre si.

Ou seja, um teste ruim é perda de espaço, quando você poderia estar rodando algo melhor. É perda de conversão. É perda de dinheiro.

Você precisa saber qual teste vai te entregar mais resultado. Então na hora de pensar: qual o próximo teste que vamos rodar, pense ao invés disso "Como será meu programa de CRO?".

Qual é a sua meta de negócio? É aumentar sua conversão? É aumentar o LTV do usuário? É aumentar o engajamento ou a retenção de usuários? Tenha em mente que essa é a meta da empresa e todo o programa de CRO deve ser ancorado nos seus OKRs.

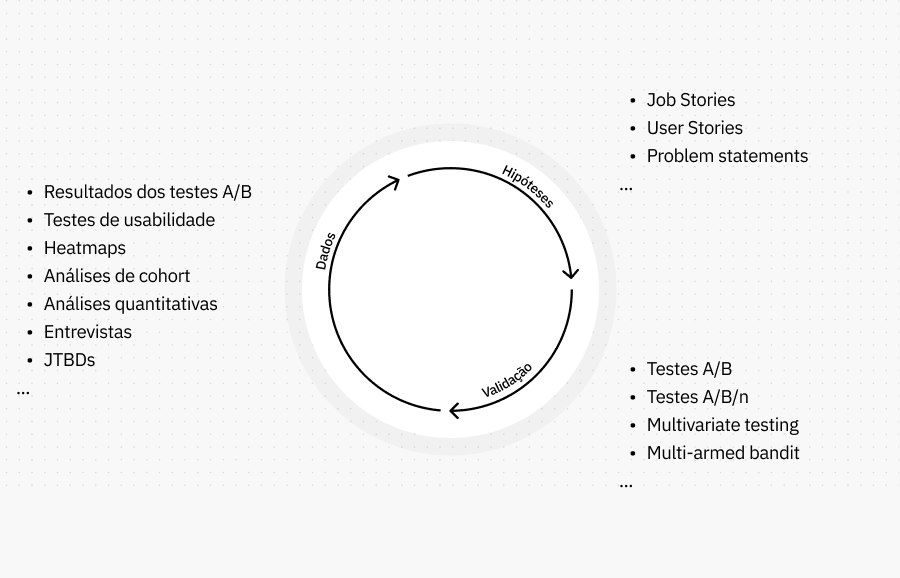

Quais informações você tem do seu usuário? Essas informações devem gerar insights, insights devem gerar hipóteses. Fontes de insights:

Com isso, passe a vincular os achados às suas OKRS.

"Insight: O usuário parece ignorar o on-boarding" > "Key Result: queremos aumentar o índice de cadastro em 20%"

Você já tem o insight que vai dar vida às suas hipóteses, e ele está vinculado à uma meta real.

"Vamos testar a cor do botão" é um teste vazio. Se pergunte por que você precisa testar a cor do botão. Vai ver se isso tem vínculo com o insight coletado ou não. Um teste pode ser micro, se você tiver muitos usuários, e 0.8% de lift (fora da margem de erro) representar um crescimento financeiro significativo. Essa não é a realidade de 99% do mercado.

Crie hipóteses disruptivas:

Um teste bem sucedido é aquele que gera lift real. Mas o contrário não é verdade: um teste mal sucedido não é aquele que não produz crescimento. Um teste mal sucedido é aquele que não gera insights para o próximo teste. Se o seu resultado é linear, não tem crescimento algum, então sua hipótese é ruim. Por conta disso criamos testes ancorados em pesquisa com usuários. A chance de testes não gerarem insumos é muito baixa dessa maneira.